L’Intelligenza Artificiale (IA) sta rivoluzionando il mondo, modificando radicalmente il modo in cui viviamo e lavoriamo. In Europa, questa tecnologia ha visto una crescita esponenziale, spingendo la necessità di creare un quadro normativo che garantisca l’uso sicuro ed etico della tecnologia. Con l’AI Act, l’Unione Europea è diventata il primo blocco economico mondiale a regolamentare l’IA in modo organico e strutturato. Ma cosa prevede questa normativa e quali sono le implicazioni per aziende, professionisti e cittadini? In questo articolo esploreremo in dettaglio l’AI Act, analizzando i cambiamenti che porterà e come influenzerà il futuro dell’intelligenza artificiale in Europa.

Perché l’Europa ha deciso di regolamentare l’IA?

Il bisogno di una regolamentazione sull’IA nasce dall’esigenza di bilanciare innovazione e sicurezza. Senza regole chiare, l’IA può comportare rischi significativi, come bias algoritmici, violazioni della privacy e impatti negativi sui diritti umani, per questo l’Europa ha deciso di intervenire con una normativa che punta a creare un ambiente tecnologico sicuro, promuovendo l’uso responsabile dell’IA.

L’AI Act si inserisce in un contesto di forte attenzione globale: mentre gli Stati Uniti e la Cina si concentrano maggiormente su aspetti legati all’innovazione e alla competitività, l’Unione Europea pone l’accento sulla protezione dei diritti fondamentali e sulla trasparenza. Questa differenza di approccio potrebbe rappresentare una sfida, ma anche un’opportunità per posizionare l’Europa come leader nella regolamentazione etica dell’IA.

AI Act vs. altre normative internazionali

L’AI Act non è un’iniziativa isolata, ma si inserisce in un panorama internazionale dove ogni blocco economico e paese sta cercando di definire il proprio approccio alla regolamentazione dell’IA. Negli Stati Uniti, ad esempio, la regolamentazione è meno centralizzata, con ogni stato che può stabilire le proprie leggi. Questo può portare a un ambiente più flessibile per l’innovazione, ma anche a una mancanza di protezione uniforme per i cittadini. In Cina, l’approccio è fortemente focalizzato sul controllo statale, con un uso dell’IA che spesso ignora la protezione dei diritti individuali a favore della sorveglianza.

L’Unione Europea, con l’AI Act, mira a creare un equilibrio tra innovazione e protezione dei diritti. Questa strategia potrebbe diventare un punto di riferimento globale per una regolamentazione responsabile, facendo emergere l’Europa come esempio virtuoso nel mondo della tecnologia etica. Tuttavia, questo approccio necessita di un’applicazione rigorosa e di una cooperazione internazionale per affrontare sfide come la globalizzazione dei dati e la competitività del mercato.

Quali livelli di rischio sono classificati le IA?

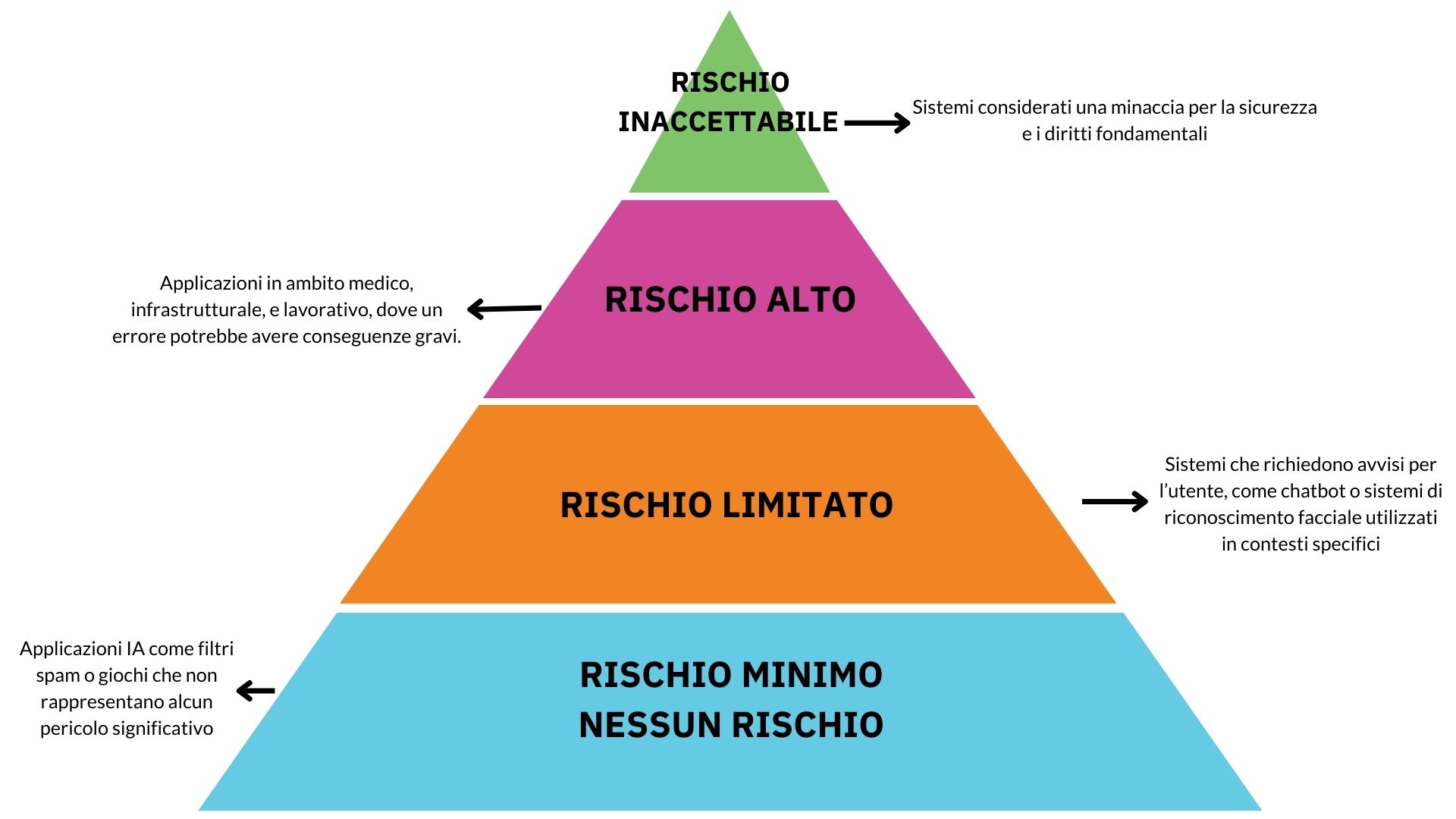

L’AI Act suddivide i sistemi di IA in base al loro livello di rischio, stabilendo regole specifiche per ciascuna categoria:

- Rischio Inaccettabile: sistemi considerati una minaccia per la sicurezza e i diritti fondamentali, come l’IA usata per il controllo sociale o la manipolazione del comportamento sono vietati.

- Rischio Alto: include applicazioni in ambito medico, infrastrutturale, e lavorativo, dove un errore potrebbe avere conseguenze gravi. Questi sistemi devono rispettare requisiti stringenti, come trasparenza, documentazione dettagliata e audit regolari. Ad esempio, i sistemi di IA utilizzati per analizzare i CV dei candidati in fase di assunzione devono garantire l’assenza di bias e un trattamento equo di tutti i dati personali.

- Rischio Limitato: sistemi che richiedono avvisi per l’utente, come chatbot o sistemi di riconoscimento facciale utilizzati in contesti specifici. Qui, la trasparenza è cruciale: gli utenti devono sapere quando interagiscono con una macchina e avere la possibilità di chiedere spiegazioni sui processi decisionali.

- Rischio Minimo o Nessun Rischio: applicazioni IA come filtri spam o giochi che non rappresentano alcun pericolo significativo. Questi sistemi sono esenti da obblighi regolatori, ma devono comunque rispettare le norme generali di sicurezza.

Per ogni livello di rischio, l’AI Act definisce obblighi specifici in termini di trasparenza, tracciabilità e sicurezza, con l’obiettivo di prevenire abusi e garantire la fiducia degli utenti.

Esempi di applicazioni IA regolamentate

- Sanità: gli algoritmi di diagnosi medica devono garantire elevati standard di accuratezza e trasparenza. Ad esempio, un sistema che analizza immagini radiografiche per individuare tumori rientra nella categoria ad alto rischio e deve sottostare a rigorose verifiche di sicurezza.

- Trasporti: i sistemi di guida autonoma, essendo ad alto rischio, necessitano di certificazioni specifiche che garantiscano la sicurezza sia per i passeggeri che per il pubblico. L’AI Act richiede che ogni nuovo modello di veicolo a guida autonoma venga testato e certificato per evitare incidenti.

- Finanza: le IA utilizzate per valutare la solvibilità dei clienti bancari devono essere prive di bias e trasparenti nei criteri di valutazione. In caso contrario, potrebbero discriminare inconsapevolmente determinate categorie di persone, andando contro i principi dell’AI Act.

Implicazioni per le aziende e i professionisti

Per le aziende che sviluppano o utilizzano IA, l’AI Act comporta una serie di adeguamenti necessari. Innanzitutto, i produttori di sistemi IA ad alto rischio dovranno ottenere certificazioni di conformità prima di poter mettere sul mercato i loro prodotti. Saranno richieste valutazioni di impatto e monitoraggi continui per garantire che i sistemi funzionino come previsto e non introducano rischi inattesi.

Le piccole e medie imprese (PMI) potrebbero trovarsi di fronte a sfide significative in termini di costi e competenze necessarie per adeguarsi alla normativa. Tuttavia, l’AI Act rappresenta anche un’opportunità: un contesto regolamentato può aumentare la fiducia degli utenti e aprire nuove possibilità di mercato, specialmente per chi riuscirà a distinguersi rispettando gli standard di sicurezza e trasparenza richiesti.

Cosa cambia per i cittadini

Per i cittadini, l’AI Act rappresenta una tutela fondamentale, tra i principali vantaggi la normativa garantisce maggiore trasparenza sui sistemi IA, offrendo agli utenti il diritto di sapere quando interagiscono con una macchina e quali sono le logiche che governano tali interazioni. Ad esempio, i sistemi di IA usati per prendere decisioni che impattano sulla vita delle persone, come l’assunzione di un lavoratore o l’erogazione di un prestito, dovranno essere trasparenti e spiegabili.

Inoltre, l’AI Act promuove una protezione rafforzata dei dati personali, limitando l’uso improprio di tecnologie invasive come il riconoscimento facciale in spazi pubblici. Questo è un passo importante per assicurare che l’IA venga utilizzata in modo etico, rispettando i diritti e le libertà dei cittadini.

Pro e contro della normativa

Nonostante i benefici, l’AI Act ha suscitato anche diverse critiche. Alcuni esperti temono che la rigidità delle regole possa frenare l’innovazione e rendere l’Europa meno competitiva rispetto a paesi come gli Stati Uniti e la Cina, dove l’approccio alla regolamentazione è meno severo. Inoltre, l’implementazione delle norme potrebbe risultare complessa, soprattutto per le PMI, che potrebbero non disporre delle risorse necessarie per rispettare tutte le nuove disposizioni.

Altri osservano che, sebbene l’intenzione dell’AI Act sia quella di proteggere i diritti dei cittadini, la sua efficacia dipenderà molto da come verrà applicato e monitorato. La sorveglianza del mercato e l’effettiva capacità di sanzionare i trasgressori saranno cruciali per il successo della normativa.

Come prepararsi al cambiamento: consigli per le aziende

Per le aziende, prepararsi all’AI Act significa intraprendere un percorso che non riguarda solo l’adeguamento normativo, ma anche un cambiamento culturale. Ecco alcuni consigli pratici per iniziare:

- Effettua un audit interno: valuta quali sistemi IA sono presenti in azienda e quali rientrano nelle categorie a rischio.

- Forma il personale: investi nella formazione continua dei tuoi dipendenti, soprattutto per chi si occupa di IA e sicurezza.

- Scegli partner affidabili: collabora con consulenti esperti che possono guidarti nel processo di conformità.

- Adotta un sistema di monitoraggio continuo: non basta adeguarsi una volta; è essenziale mantenere un controllo continuo sui sistemi IA per assicurarsi che restino conformi nel tempo.

Il Futuro dell’Intelligenza Artificiale in Europa

L’AI Act rappresenta un cambiamento epocale per l’Europa, tracciando la strada verso un uso più sicuro, etico e trasparente dell’Intelligenza Artificiale. Per le aziende e i professionisti, adeguarsi alle nuove regole sarà essenziale non solo per evitare sanzioni, ma anche per guadagnare la fiducia degli utenti e sfruttare le nuove opportunità che l’IA regolamentata può offrire. In un mondo sempre più connesso e automatizzato, la capacità di innovare in sicurezza diventerà un vantaggio competitivo cruciale.

Se sei un’azienda o un professionista e vuoi capire come adeguarti al nuovo AI Act, contatta Neting. Ti aiuteremo a navigare nel complesso mondo della normativa sull’intelligenza artificiale e a integrare l’IA in modo sicuro e conforme.